language:

- fr

license: apache-2.0

tags:

- text-generation-inference

- transformers

- unsloth

- gemma

- summarizer

- lora

base_model: unsloth/gemma-2b-it-bnb-4bit

Uploaded as lora model

- Developed by: Labagaite

- License: apache-2.0

- Finetuned from model : unsloth/gemma-2b-it-bnb-4bit

Training Logs

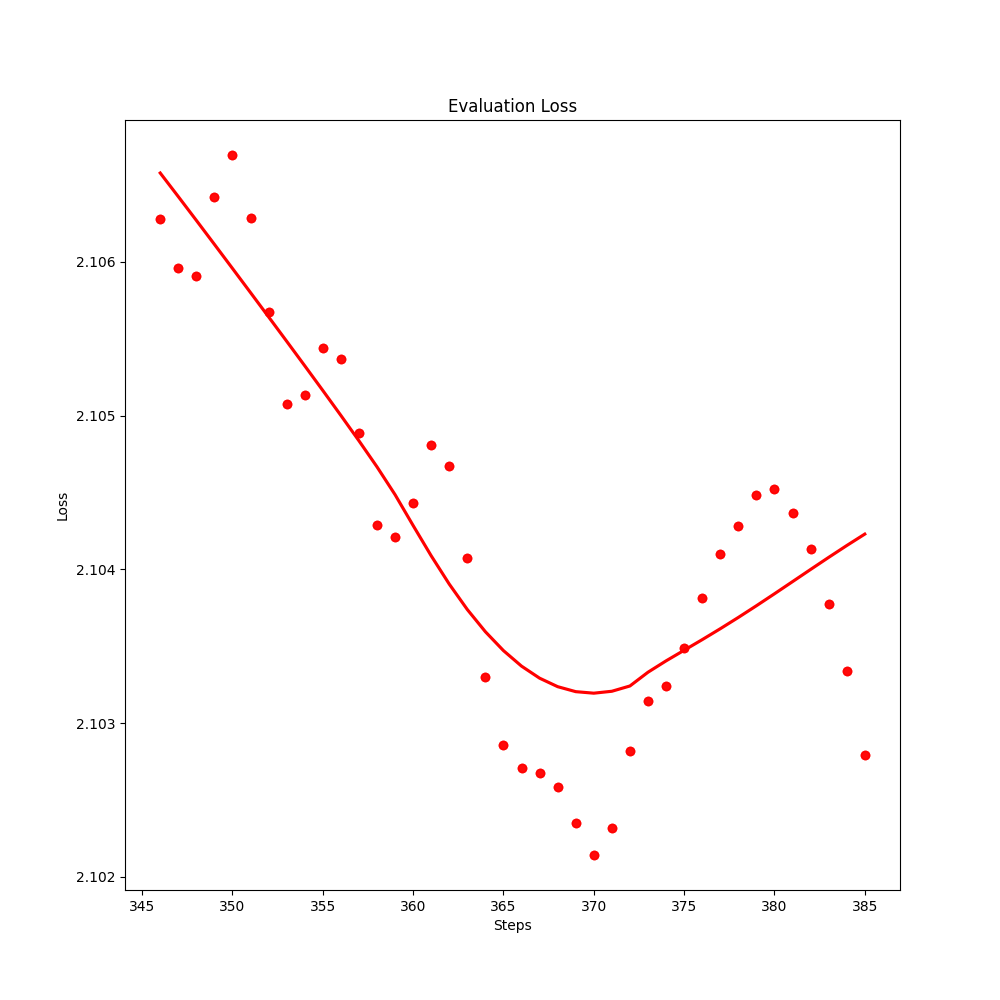

Traning metrics

Evaluation score

Évaluation des rapports générés par les modèles d'IA :

Modèle de base unsloth/gemma-2b-it-bnb-4bit :

Performance de la structuration du rapport : 5/10

- Le rapport est structuré en chapitres distincts, mais la transition entre les chapitres est parfois abrupte et manque de fluidité.

Qualité du langage : 4/10

- Le langage utilisé est correct mais manque de sophistication et de variété. Certaines phrases sont maladroites et peu claires.

Cohérence : 4/10

- La cohérence du rapport est faible, avec des idées qui semblent parfois disjointes et des transitions abruptes entre les sections.

Score global : 4.3/10

Modèle fine-tuned /home/will/LM_summarizer_trainer/model/gemma-Summarizer-2b-it-bnb-4bit :

Performance de la structuration du rapport : 7/10

- Le rapport est bien structuré en sections claires et distinctes, avec des transitions plus fluides entre les chapitres.

Qualité du langage : 6/10

- Le langage utilisé est plus sophistiqué et varié que dans le rapport du modèle de base, mais il reste quelques maladresses et répétitions.

Cohérence : 6/10

- Le rapport est plus cohérent que celui du modèle de base, avec des idées mieux connectées et des transitions plus naturelles.

Score global : 6.3/10

Conclusion :

Le modèle fine-tuned a clairement montré une amélioration par rapport au modèle de base en termes de structuration du rapport, de qualité du langage et de cohérence. Cependant, il reste encore des aspects à améliorer pour atteindre une qualité optimale. Le modèle de base a besoin d'une amélioration significative dans tous les domaines pour être considéré comme efficace. En fin de compte, le modèle fine-tuned est préférable pour générer des rapports de meilleure qualité. Evaluation report and scoring

Wandb logs

You can view the training logs .

Training details

training data

- Dataset : fr-summarizer-dataset

- Data-size : 7.65 MB

- train : 1.97k rows

- validation : 440 rows

- roles : user , assistant

- Format chatml "role": "role", "content": "content", "user": "user", "assistant": "assistant"

*French audio podcast transcription*

Project details

Fine-tuned on French audio podcast transcription data for summarization task. As a result, the model is able to summarize French audio podcast transcription data.

The model will be used for an AI application: Report Maker wich is a powerful tool designed to automate the process of transcribing and summarizing meetings.

It leverages state-of-the-art machine learning models to provide detailed and accurate reports.

This gemma model was trained 2x faster with Unsloth and Huggingface's TRL library.

This gemma was trained with LLM summarizer trainer

LLM summarizer trainer

LLM summarizer trainer

![]()